À une époque où les outils d'écriture basés sur l'intelligence artificielle (IA) sont omniprésents, la création de contenus académiques est devenue plus efficace et pratique. Cependant, une dépendance totale envers l'intelligence artificielle peut engendrer des contenus creux et du plagiat. Détecter les contenus générés par l'IA et utiliser correctement les outils d'écriture assistée par IA représente un défi que le monde académique et l'humanité doivent sérieusement considérer.

I. Caractéristiques principales et processus opérationnel de l'outil SafeAssign AI Checker

SafeAssign est un outil anti-plagiat intégré au système de gestion de l'apprentissage Blackboard, largement utilisé par des institutions comme l'Université du Maryland et l'Université de Floride. Ses principales caractéristiques incluent :

- Comparaison avec des bases de données : En s'appuyant sur des bases de données académiques telles que ProQuest et des ressources internet, il analyse près de dix milliards de documents pour détecter les similarités textuelles.

- Analyse multidimensionnelle : En combinant la correspondance de chaînes, les techniques d'empreintes digitales et l'analyse sémantique, il peut identifier à la fois le plagiat direct et les contenus réécrits par l'IA. Par exemple, même si un texte généré par l'IA remplace des synonymes, il peut être signalé en raison de structures syntaxiques inhabituelles ou d'un manque de cohérence logique.

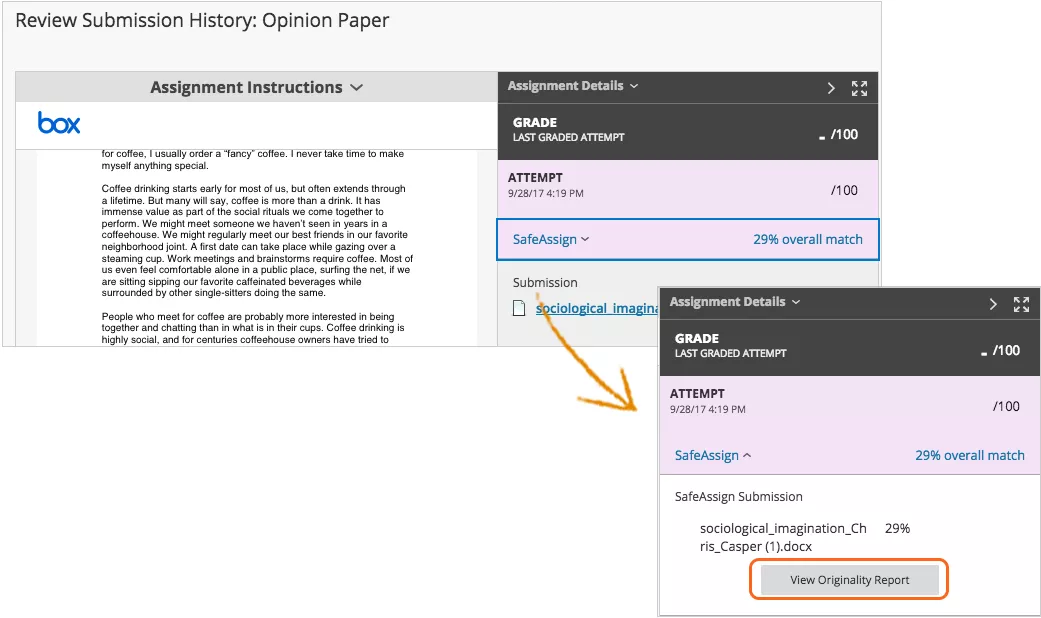

- Génération de rapports : Il fournit un pourcentage de similarité et des liens vers les sources, aidant les enseignants à repérer rapidement les passages problématiques.

Étapes opérationnelles :

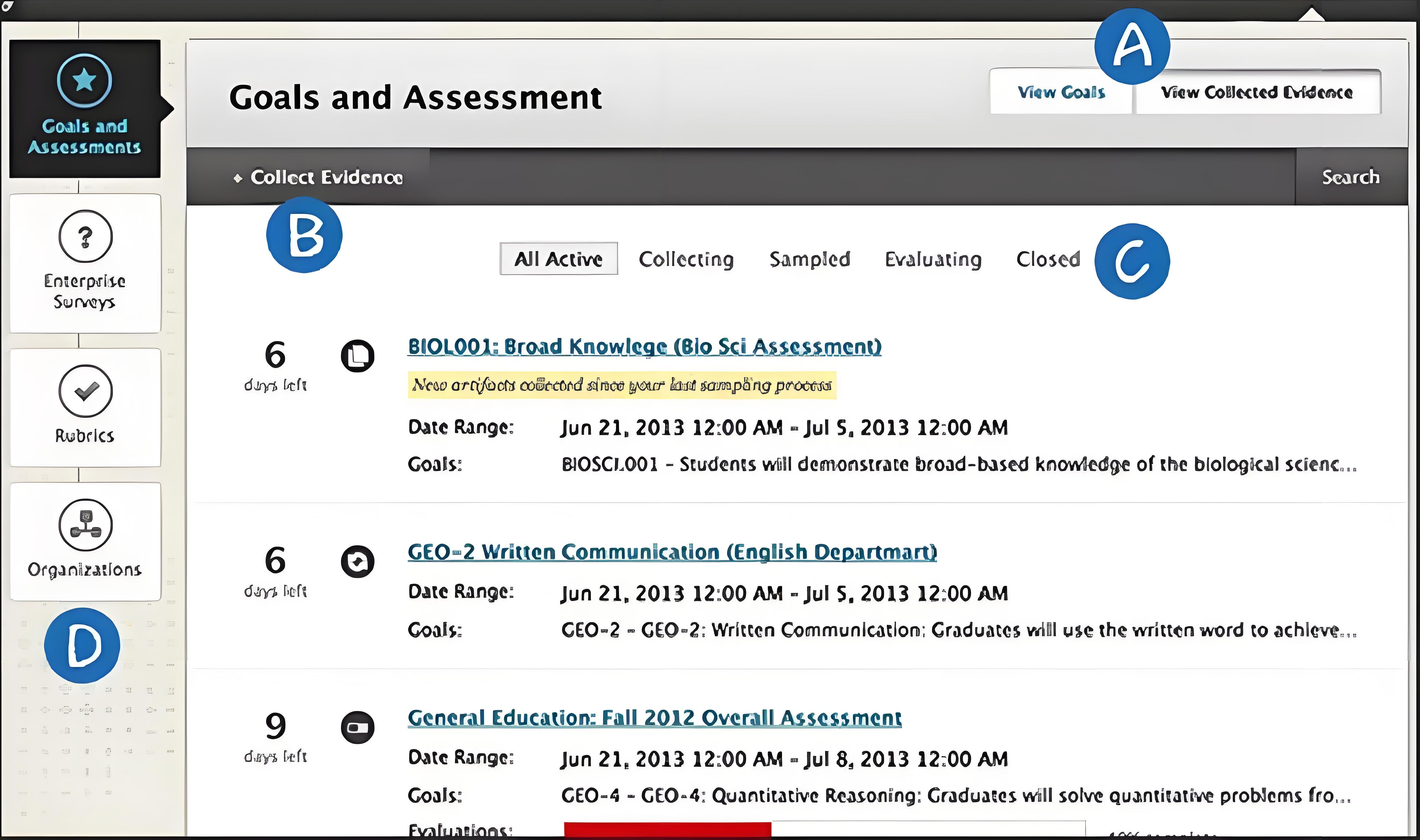

- Soumission : Une fois que les étudiants téléchargent leurs documents via la plateforme Blackboard, le système déclenche automatiquement une analyse SafeAssign.

- Interprétation du rapport : Les enseignants examinent les passages "à haut risque" (par exemple, similarité > 25 %) et, en tenant compte du contexte, déterminent s'il s'agit d'une citation raisonnable ou d'un plagiat.

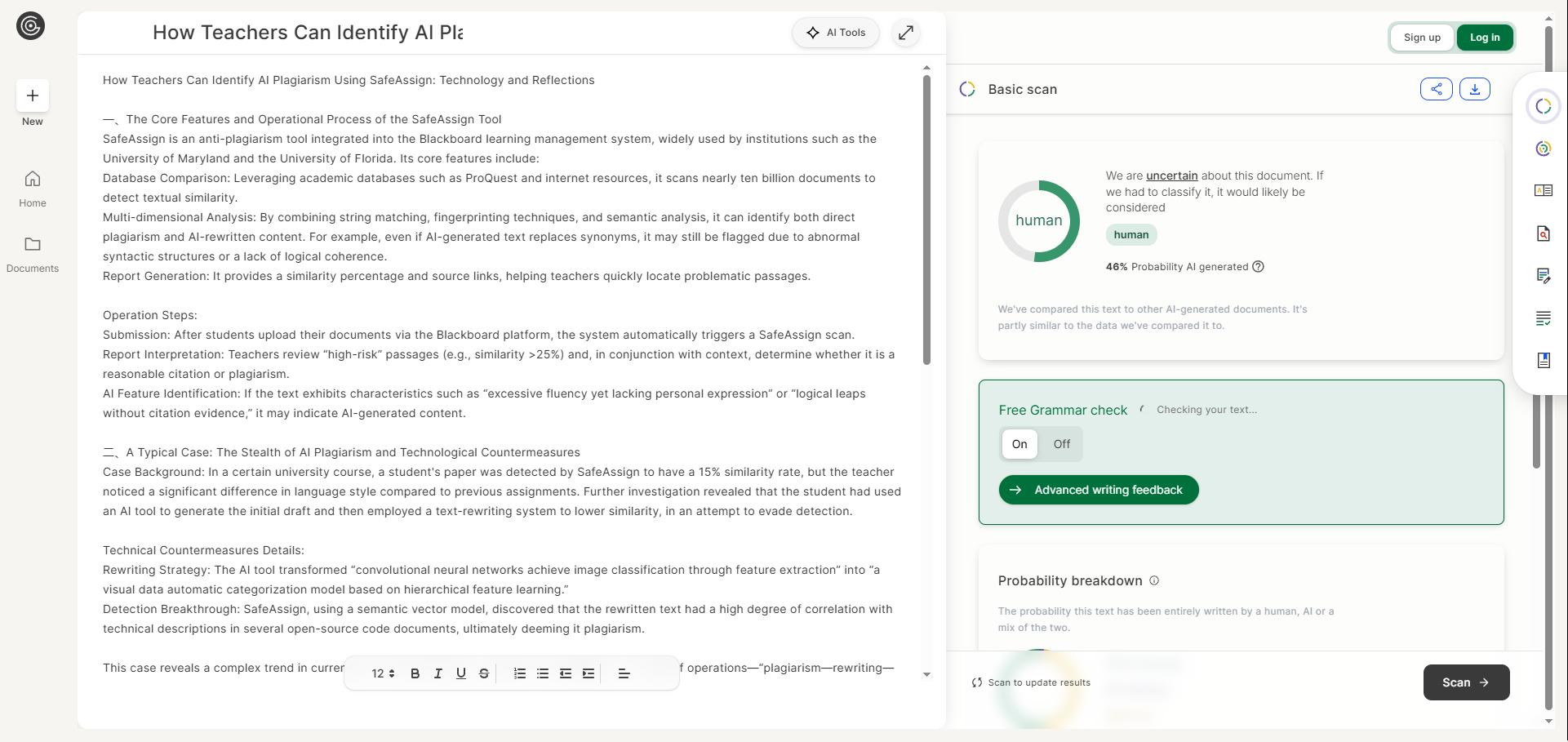

- Identification des caractéristiques de l'IA : Si le texte présente des caractéristiques telles qu'une "fluidité excessive mais un manque d'expression personnelle" ou des "sauts logiques sans preuves de citation", cela peut indiquer un contenu généré par l'IA.

II. Un cas typique : La furtivité du plagiat par IA et les contre-mesures technologiques

Contexte du cas :

Dans un cours universitaire, un devoir d'étudiant a été détecté par SafeAssign avec un taux de similarité de 15 %, mais l'enseignant a remarqué une différence significative de style linguistique par rapport aux travaux précédents. Une enquête plus approfondie a révélé que l'étudiant avait utilisé un outil d'IA pour générer un brouillon initial, puis un système de réécriture de texte pour réduire la similarité, dans une tentative d'échapper à la détection.

Détails des contre-mesures techniques :

- Stratégie de réécriture : L'outil d'IA a transformé "les réseaux neuronaux convolutifs réalisent la classification d'images grâce à l'extraction de caractéristiques" en "un modèle de catégorisation automatique des données visuelles basé sur un apprentissage hiérarchique des caractéristiques".

- Avancée dans la détection : SafeAssign, utilisant un modèle de vecteurs sémantiques, a découvert que le texte réécrit présentait un degré élevé de corrélation avec des descriptions techniques dans plusieurs documents de code open-source, le qualifiant finalement de plagiat.

Ce cas révèle une tendance complexe dans les inconduites académiques actuelles : les étudiants peuvent employer une chaîne complète d'opérations — "plagiat—réécriture—évasion de la détection" — en utilisant des outils d'IA.

III. À partir du cas de plagiat, quatre grands enjeux méritent notre attention

- Redéfinir les limites de l'intégrité académique

La technologie de l'IA a abaissé le seuil du plagiat et contraint les éducateurs à redéfinir l'"originalité". Par exemple, un incident où une équipe d'IA de l'Université Stanford s'est publiquement excusée pour avoir utilisé sans citation appropriée un code provenant d'un modèle open-source chinois reflète une faible prise de conscience des droits de propriété intellectuelle dans les collaborations de recherche mondiales. Les enseignants doivent guider les étudiants pour comprendre que, même en utilisant une assistance IA, les idées principales et l'argumentation logique doivent être construites de manière indépendante. - Le double tranchant de l'éthique technologique

La lutte entre les outils de détection comme SafeAssign et la technologie de réécriture par IA est essentiellement une compétition technique de "défense—percée". Des controverses similaires, comme le modèle OpenAI accusé de plagier du code chinois, nous avertissent qu'au-delà de la neutralité de la technologie se cache le risque d'infiltration idéologique. - Réforme adaptative des systèmes d'évaluation éducative

- Évaluation basée sur le processus : Augmenter les composantes comme les discussions en classe et les défenses en temps réel, réduisant ainsi la dépendance envers les textes standardisés.

- Formation à la littératie IA : Enseigner aux étudiants comment utiliser correctement les outils d'IA, par exemple en utilisant ChatGPT pour aider à la revue de littérature tout en rédigeant leur analyse de manière indépendante.

De nombreux cas de plagiat de modèles open-source exposent les limites des normes académiques actuelles dans les collaborations transnationales. Les mécanismes suivants doivent être établis :

- Standardisation des licences open-source : Définir clairement les droits d'utilisation pour le code, les données et les modèles.

IV. Conclusion : Préserver l'éclat de l'humanité au milieu du déluge technologique

SafeAssign n'est pas seulement un outil de détection, mais aussi un miroir reflétant l'écosystème académique. Lorsque les étudiants utilisent l'IA pour générer des "devoirs parfaits", ils perdent l'opportunité d'affiner leurs compétences en pensée critique ; lorsque les institutions de recherche privilégient les "solutions techniques rapides", elles négligent l'esprit originel du partage des connaissances. Peu importe comment la technologie évolue, l'intégrité, l'innovation et le soin humaniste demeurent les fondations de la civilisation humaine. Le but ultime de l'éducation n'est pas de former des "experts en évasion de détection de plagiat", mais de cultiver des individus qui pensent de manière indépendante et vénèrent le savoir. Ce n'est qu'ainsi que nous pourrons sortir du cycle "plagiat—détection—contre-mesure" à l'ère de l'IA et avancer vers une véritable liberté académique et une innovation authentique.